BigQueryの基本知識

BigQueryは、Google Cloudが提供する、クラウド上で稼働するデータウェアハウスで、大量のデータを簡単に格納、クエリ、分析できます。BigQueryは、SQLを使ったクエリ言語をサポートしており、簡単にデータを取得、結合、集計することができます。また、ビッグデータを処理するために、Googleのインフラストラクチャと技術を利用しています。

BigQueryを活用するメリット

BigQueryを活用することで、GA4の生データをどこまで柔軟に扱えるのか、また専門知識やAIサポートの有無によってどんな違いが出てくるのかを、この章では3つの観点から整理して紹介します。

GA4で取得したデータを直接分析できる

BigQueryは、GA4(Google Analytics 4)と標準で連携しており、GA4で収集したイベントデータを自動的にエクスポートできます。これにより、GA4の管理画面では見られない詳細な行動データを、制限なく分析できるのが大きな特徴です。サンプリングのない生データを扱えるため、正確なトレンド分析やユーザーセグメントの抽出が可能になります。また、広告や売上、CRMなど他のデータソースと統合することで、「来訪から購買まで」の一連の行動を横断的に可視化できます。GA4で取得したデータを“そのまま”自由に扱えることが、BigQueryを活用する最大のメリットのひとつです。

分析のために専門的な知識を必要としない

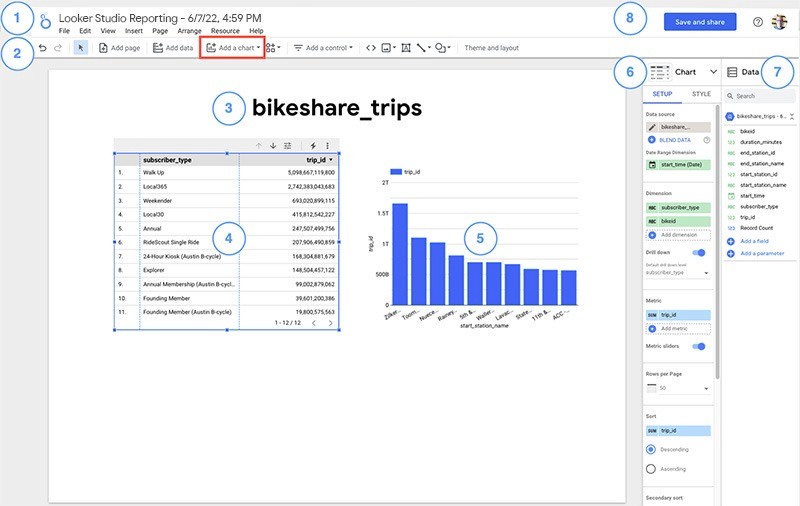

BigQueryは、SQLという標準的な言語で操作できるため、高度なプログラミング知識は不要でデータ分析を始められます。Google Cloudコンソールには補完機能やクエリテンプレートも用意されており、初心者でも直感的に操作できます。また、Looker StudioなどのBIツールと連携すれば、コードを書かずにグラフやダッシュボードを作成でき、データをチームで共有することも容易です。これまで分析を専門部署に任せていた企業でも、マーケティング担当者や経営層が自らデータにアクセスし、意思決定に活かせるようになります。BigQueryは、専門職以外でも意思決定に活かせる分析基盤を提供するツールといえます。

Gemini in BigQueryでAIが分析をサポート

Gemini in BigQueryとは、BigQueryでの分析をサポートするAIです。Gemini in BigQueryを活用すると、以下の4つの作業を支援してもらえます。

現在まだプレビューとなっている機能もあるため、今後機能が増えることが予測されます。

データインサイトでデータを探索、理解

データインサイトは、BigQuery内のテーブルのメタデータをもとに、AIが自動で傾向やパターンを検出する機能です。

複雑なクエリを記述しなくても、Geminiが統計的な分析を実行し、「どの指標が増減しているか」「どの要素が影響しているか」といった初期インサイトを提示します。特に、初めて新しいデータを探索する際の“コールドスタート”を防ぎ、分析の出発点をつくるのに役立ちます。

データキャンバスでデータを検出・変換・クエリ・可視化

Gemini in BigQueryで、自然言語を使用して入力すると、テーブルアセットの検索や結合、クエリ、結果の可視化などを実行できます。例えば、「過去3か月のトラフィック推移をグラフで表示して」と入力するだけで、必要なテーブル検索から可視化まで自動実行されます。さらに、プロジェクトメンバーと同じ画面上でコラボレーションでき、分析プロセスの共有もスムーズです。

SQL・Pythonのコード生成

Gemini in BigQueryは、SQLやPythonのコード生成もサポートします。自然言語プロンプトからクエリを自動生成したり、既存のSQLを解説できます。

代表的な利用例には以下があります。

SQLクエリを生成するプロンプト作成

Pythonコードの生成

Pythonコードの補完

AIによるデータ準備

Gemini in BigQueryは、データクレンジングに対応しています。テーブル情報から提案されたいくつかのデータ加工内容を用いて、データ加工処理を行えます。提案される加工内容としては、データ型の変換やデータの抽出条件などがあります。

この機能をつかえば、SQLに馴染みがなくても簡単にデータ加工処理を行えます。

料金体系(2026年3月時点)

BigQueryの料金は、主にコンピューティング料金とストレージ料金で構成されます。そのほか、ストリーミング読み取りや書き込みなど、一部のオペレーションにも料金が発生します。

コンピューティングには、オンデマンドコンピューティング料金と容量コンピューティング料金という2種類の料金モデルが用意されています。

オンデマンドコンピューティング料金は、実行したクエリで処理したデータ量に応じて課金されます。1TiBあたり6.25ドルで、請求は1ヶ月ごとにアカウント単位で集計されます。毎月1TiBまでのクエリ処理は無料枠として提供されています。

容量コンピューティング料金は、あらかじめ確保したクエリ処理容量に対して定額で支払うモデルです。費用を予測しやすくしたい場合や、一定以上の利用が見込まれる場合に検討されます。

ストレージ料金は、BigQueryに格納したデータ量に応じて発生します。アクティブストレージと長期保存ストレージで単価が異なり、90日間変更がないデータは自動的に長期保存料金の対象となります。毎月10GiBまでのストレージは無料枠として提供されています。

料金体系の詳細は、公式ドキュメント「BigQuery の料金」を確認してください。

データの読み込み方法

BigQueryへのデータ取り込みには、大きく分けて「自動連携」と「手動取り込み」があります。GA4のようなGoogleサービスとの自動連携については後述しますので、ここではCSVファイルのアップロードやAPIを使った取り込みなど、手動での取り込み方法を解説します。

データ読み込み方法

ローカルファイルからの読み込み 手元にあるCSV、JSON、AVRO、ParquetなどのファイルをBigQueryにアップロードする方法です。以下は、CSVファイルをアップロードする手順です。

BigQuery Storage Write APIを使用 アプリケーションからリアルタイムにデータを挿入するには、BigQuery Storage Write APIを使用します。これにより、遅延を抑えてデータをBigQueryにストリーミングできます。 Pythonでの例:

※ 旧APIの tabledata.insertAll も利用可能ですが、現在はStorage Write APIの利用が推奨されています。 外部データソースを使用 BigQueryでは「フェデレーテッドクエリ(外部データ接続)」を使って、外部ストレージに保存されたデータを直接クエリできます。対応する外部データソースには、Cloud Storage、Cloud Bigtable、Cloud SQL、Google Sheets、(制限付きで)Google Driveなどがあります。以下は、Cloud Storageから外部テーブルを作成する例です。

|

GA4とBigQueryの連携方法

Google Analytics 4(GA4)とBigQueryを連携すると、GA4で収集されたイベントデータをBigQueryに自動エクスポートでき、詳細な行動分析やカスタムレポート、BIツールでの可視化が可能になります。

1.BigQueryのプロジェクトを作成する

Google Cloud ConsoleでBigQueryのプロジェクトを作成し、BigQuery APIを有効化します。GA4を管理するGoogleアカウントに、プロジェクトの編集権限を付与してください。

2.GA4のデータをBigQueryにエクスポートする

GA4の管理画面で「管理」>「BigQueryリンク」を開き、「リンクを作成」をクリックします。エクスポート先のBigQueryプロジェクトとデータセットを選択しデータ保存頻度(例:日次)を設定します。スキーマは自動的に作成され、イベントデータは日別テーブル(events_YYYYMMDD)として保存されます。

GA4のStandardプロパティ(通常版)でも、日次エクスポートおよびストリーミングエクスポートのいずれも選択可能です。一方でGA4 360では、日次エクスポートの中でもより鮮度の高いデータを出力できるFresh daily exportなど、追加のエクスポート機能が提供されます。

3.BigQueryでデータをクエリする

BigQueryコンソールからデータセットを選択し、SQLを使って分析を行います。たとえば、特定ページの閲覧数を取得するクエリは次の通りです。

SELECT

ep.value.string_value AS page_path,

COUNT(*) AS pageviews

FROM

`PROJECT_ID.dataset.events_*`,

UNNEST(event_params) AS ep

WHERE

event_name = 'page_view'

AND ep.key = 'page_path'

AND _TABLE_SUFFIX BETWEEN '20250101' AND '20250131'

GROUP BY

page_path

ORDER BY

pageviews DESC;

クエリ結果はテーブル形式で確認でき、Looker StudioやTableauなどと連携すれば、グラフやダッシュボードとして可視化も可能です。

連携が正しくできているかの確認方法

GA4とBigQueryの連携が正しく完了すると、リンク設定時に指定したBigQueryプロジェクト内に、analytics_<プロパティID> という名前のデータセットが自動で作成されます。データセット内には、events_YYYYMMDD の形式で日次テーブルが生成され、エクスポートが成功していれば、翌日以降に新しい日付のテーブルが追加されていきます。BigQueryコンソールでこれらのテーブルが確認できれば、連携は正常に行われています。また、GA4管理画面の[管理]>[BigQueryリンク]でもリンク状態を確認できます。データが生成されない場合は、プロジェクトの権限やAPI設定を見直すことが推奨されます。

BigQueryを使ったGA4データの分析方法

GA4データをBigQueryで分析するには、まずGA4とBigQueryを連携させ、GA4で収集したイベントデータを自動的にエクスポートします。エクスポート設定は、GA4管理画面の「管理」>「BigQueryリンク」から行い、出力先のBigQueryプロジェクトとデータセットを選択します。エクスポート後、GA4のイベントデータは events_YYYYMMDD の形式で日次テーブルとして保存されます。

1.GA4データのエクスポート

GA4のイベントデータは、BigQueryに自動的に転送されます。スキーマはGoogleによって自動生成され、イベント、ユーザー、パラメータなどの情報がネスト構造で格納されます。エクスポートが完了すると、指定したデータセット内に events_ で始まる日別テーブルが作成され、毎日新しいテーブルが追加されます。

2.データのクエリ

BigQueryでは、SQLを使用してGA4データを自由に分析できます。たとえば、特定のページのページビュー数を取得するクエリは次のようになります。

SELECT

ep.value.string_value AS page_path,

COUNT(*) AS pageviews

FROM

`PROJECT_ID.dataset.events_*`,

UNNEST(event_params) AS ep

WHERE

event_name = 'page_view'

AND ep.key = 'page_path'

AND _TABLE_SUFFIX BETWEEN '20250101' AND '20250131'

GROUP BY

page_path

ORDER BY

pageviews DESC;

このクエリでは、GA4のイベントデータから page_view イベントを対象に、期間内のページパス(page_path)ごとの閲覧回数を集計します。クエリを実行すると、結果はBigQuery上でページ別の閲覧回数としてテーブル形式で表示されます。

3.データの可視化

引用:Google Cloud|Looker Studioでデータを分析する

BigQueryは、Looker StudioやTableauなどのBIツールと連携できます。クエリ結果をそのままグラフ化したり、ダッシュボードを作成することで、サイトのパフォーマンスやユーザー行動を視覚的に把握できます。これにより、非エンジニアでも分析結果を直感的に理解し、意思決定に活用することが可能になります。